Wprowadzenie

Unijny AI Act to pierwsza na świecie kompleksowa regulacja dotycząca sztucznej inteligencji. Pierwsze elementy rozporządzenia zaczynają obowiązywać już w 2025 roku, a pełna egzekucja przepisów wejdzie w życie stopniowo do 2026–2027. Firmy działające na rynku europejskim niezależnie od branży muszą przygotować się na nowe obowiązki, szczególnie jeśli stosują AI do przetwarzania danych, analizowania dokumentów czy automatyzacji procesów. Celem regulacji jest zwiększenie bezpieczeństwa użytkowników, przejrzystości działania systemów oraz ograniczenie ryzyka nadużyć.

Czym jest AI Act?

AI Act wprowadza zasady odpowiedzialnego korzystania ze sztucznej inteligencji. Jego fundamentem jest podejście oparte na ryzyku obowiązki rosną wraz ze wzrostem potencjalnego zagrożenia, jakie system AI może stwarzać dla obywateli lub organizacji.

Poziomy ryzyka w AI Act

Regulacja dzieli systemy AI na cztery poziomy ryzyka, które można zobrazować piramidą.

Niedopuszczalne ryzyko – systemy zagrażające prawom człowieka (np. masowa inwigilacja biometryczna). Są zakazane.

Wysokie ryzyko – systemy stosowane w obszarach takich jak: zdrowie, edukacja, transport, rekrutacja, infrastruktura krytyczna. Wymagają certyfikacji, oceny zgodności, pełnej dokumentacji oraz ścisłego nadzoru człowieka.

Ograniczone ryzyko – AI w interakcjach z użytkownikami, np. chatboty. Obowiązek informowania o użyciu AI i zapewnienia przejrzystości.

Minimalne ryzyko – systemy, które nie stwarzają zagrożeń dla użytkownika. Mogą być stosowane swobodnie.

AI Act- kogo dotyczy w praktyce?

Większość firm korzysta z narzędzi AI działających na niskich lub minimalnych poziomach ryzyka, co oznacza brak dużych obciążeń regulacyjnych jednak nadal konieczne jest zachowanie przejrzystości i zgodności z ogólnymi zasadami odpowiedzialnego przetwarzania danych.

Anonimizacja a AI Act

Anonimizacja dokumentów i danych staje się kluczowa z dwóch powodów. Po pierwsze, zmniejsza ryzyko prawne jeśli dane są anonimizowane, nie podlegają rygorom ochrony danych osobowych. Po drugie, AI Act wymaga, aby dane wykorzystywane do trenowania modeli były legalne, bezpieczne i minimalizowane. Anonimizacja jest więc jednym z najskuteczniejszych sposobów, by spełnić ten wymóg i nadal wykorzystywać dokumenty do budowy własnych modeli.

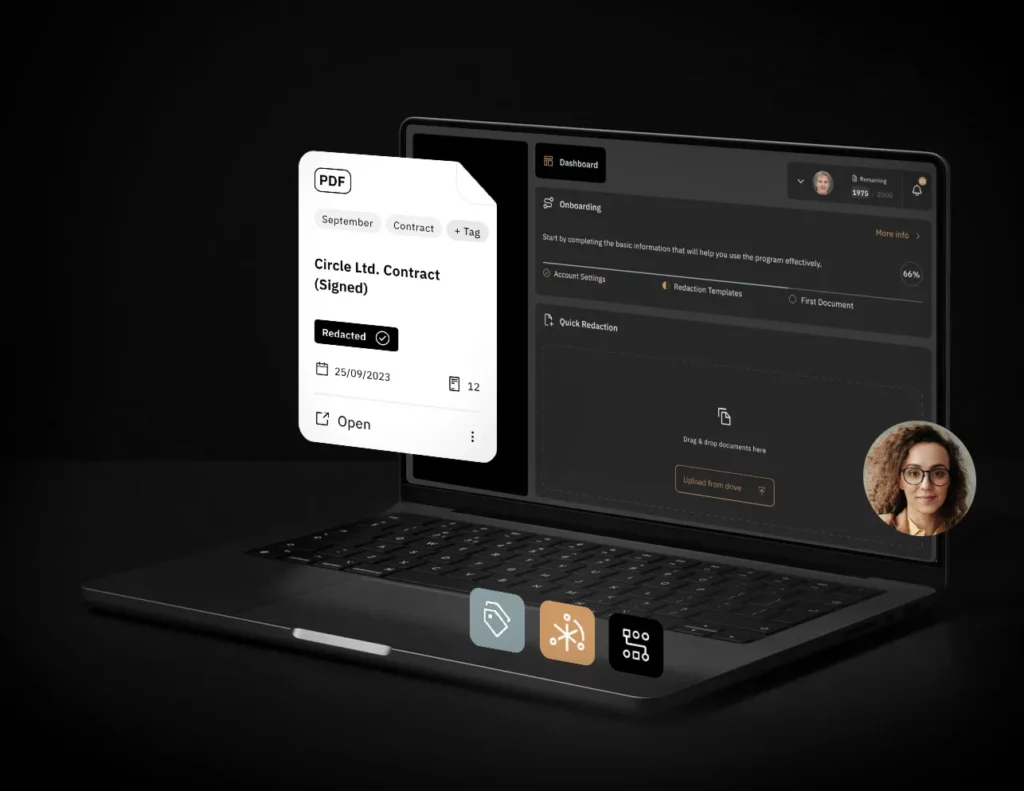

Czy Bluur spełnia wymogi AI Act?

Bluur należy do kategorii systemów o minimalnym poziomie ryzyka, co oznacza, że nie wymaga ciężkiej procedury zgodności ani certyfikacji charakterystycznej dla systemów wysokiego ryzyka. Mimo to rozwiązanie wdraża dobre praktyki zgodne z założeniami AI Act takie, które zwiększają przejrzystość, kontrolę nad procesem i bezpieczeństwo danych:

- Przejrzystość współpracy AI i człowieka – użytkownik zawsze wie, kiedy działa algorytm, a kiedy on sam.

- Rejestrowanie operacji – system zapisuje, kto i kiedy pracował nad dokumentem (człowiek lub AI).

- Brak autonomicznych decyzji – AI w Bluur nigdy nie działa samodzielnie w kluczowych momentach; ostateczna decyzja należy do użytkownika.

- Pełna dokumentacja użycia i monitoring – umożliwia audyt, analizę pracy oraz zgodność z wymaganiami regulacyjnymi.

Połączenie tych elementów sprawia, że Bluur nie tylko spełnia standardy AI Act dla niskiego ryzyka, ale wręcz je przewyższa.

Bluur jako wsparcie zgodności z AI Act w trenowaniu modeli

Akt wprowadza również obowiązki dotyczące datasetów treningowych. Jeśli firma chce tworzyć lub doszkalać modele AI na podstawie własnych dokumentów, musi zapewnić, że dane nie naruszają prywatności ani praw osób fizycznych. Bluur umożliwia pełną anonimizację dokumentów przed ich użyciem do trenowania modeli. Dzięki temu firmy mogą legalnie tworzyć własne, domenowe modele, jednocześnie pozostając w zgodzie z unijnymi regulacjami.

Podsumowanie

AI Act to nowość, która ma zwiększyć bezpieczeństwo użytkowników i uporządkować rynek systemów sztucznej inteligencji. Choć regulacja w największym stopniu dotknie systemy działające w obszarach wysokiego ryzyka, wszystkie firmy korzystające z AI powinny przygotować się na większą przejrzystość i odpowiedzialność w przetwarzaniu danych. Bluur jest przykładem rozwiązania, które naturalnie wpisuje się w te wymagania dzięki anonimizacji dokumentów, audytowalności oraz kontroli nad procesem, może być realnym wsparciem w budowaniu zgodności z aktem, szczególnie w projektach związanych z dalszym przetwarzaniem danych czy trenowaniem modeli.